研究人员已经使用人工智能来减少依靠计算机与他人交谈的非语言运动障碍人士的“沟通鸿沟”。

来自剑桥大学和邓迪大学的团队开发了一种新的情境感知方法,该方法可以消除用户键入以进行交流的50%到96%的击键次数,从而缩小了交流差距。

该系统专门针对非语言人群,并使用一系列上下文“线索”(例如用户的位置,一天中的时间或用户的讲话伙伴的身份)来帮助建议与用户最相关的句子。

非言语运动障碍人士经常使用带有语音输出功能的计算机与他人交流。但是,即使没有肢体残疾影响打字的过程,这些交流辅助工具仍然太慢并且容易出错,无法进行有意义的对话:典型的打字速度在每分钟5到20个单词之间,而典型的说话速度在100到100范围内。每分钟140个字。

研究的主要作者,剑桥大学工程系的珀·奥拉·克里斯滕森教授说:“通信速率的差异被称为通信差距。” “这种差距通常在每分钟80到135个单词之间,并且影响了依赖计算机进行交流的人们的日常交互质量。”

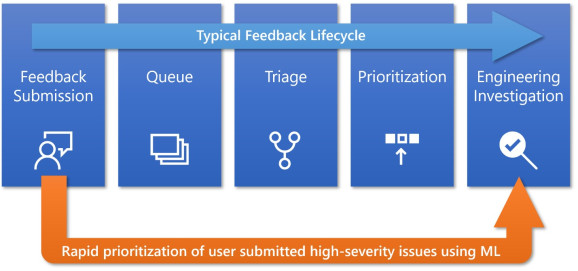

克里斯滕森(Kristensson)和他的同事开发的方法使用人工智能来允许用户快速检索他们过去键入的句子。先前的研究表明,依赖语音合成的人们,就像其他所有人一样,倾向于在日常对话中重用许多相同的短语和句子。然而,对于现有语音合成技术的用户而言,检索这些短语和句子是一个耗时的过程,从而进一步减慢了对话的流程。

在新系统中,随着人员的键入,系统会使用信息检索算法根据键入的文本和人员所参与的会话的上下文自动检索最相关的先前句子。上下文包括有关会话的信息,例如位置,一天中的时间以及自动识别对方的脸孔。使用经过训练可从前置摄像头识别人脸的计算机视觉算法来识别其他说话者。

该系统是使用通常用于喷气发动机或医疗设备的设计工程方法开发的。研究人员首先确定了系统的关键功能,例如单词自动完成功能和句子检索功能。在确定了这些功能之后,研究人员模拟了一个非语言人,该人从一个代表非语言人想要交流的文本类型的句子集中输入大量的句子。

通过这种分析,研究人员可以了解检索句子的最佳方法以及一系列参数对性能的影响,例如自动完成单词的准确性以及使用许多上下文标签的影响。例如,此分析表明,只需两个合理准确的上下文标签即可提供大部分收益。自动完成功能可以起到积极的作用,但对于实现大部分收益并不是必不可少的。使用类似于网络搜索的信息检索算法来检索句子。将上下文标记添加到用户键入的单词以形成查询。

这项研究是第一个将情境感知信息检索与语音生成设备集成在一起的,以帮助行动不便的人,证明了上下文相关的人工智能如何改善行动不便者的生活。

克里斯滕森说:“这种方法使我们希望有更多创新的注入AI的系统来帮助行动不便的人将来进行交流。” “我们已经证明,通过注入AI的用户界面可以挑战传统用户界面设计理念和流程,从而减少不进行创新研究的机会成本。”